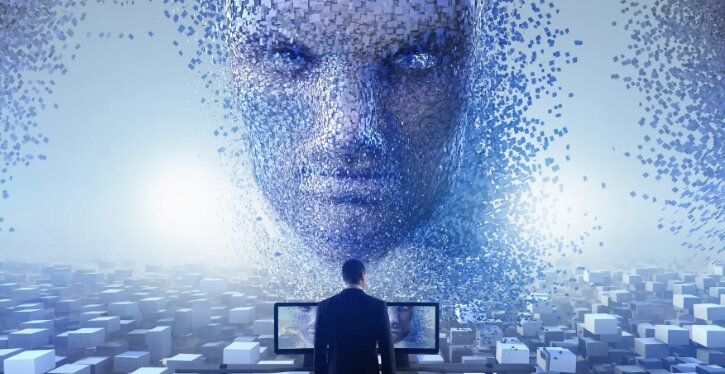

به این دلیل هیچ وقت به هوش مصنوعی اعتماد نکنید!

هنگامی که الکسا به این شکل پاسخ میدهد، واضح است که منافع توسعهدهندهی خود را به منافع شما ترجیح میدهد. با این حال، معمولا مشخص نیست که یک سیستم هوش مصنوعی به چه کسی خدمت میکند.

برای جلوگیری از مورد سوء استفاده قرار گرفتن توسط این سیستمها، مردم باید یاد بگیرند که با شک و تردید به هوش مصنوعی نزدیک شوند. این بدان معناست که تعمدا ورودیهایی را که به آن میدهید بسازید و به طور نقادانه در مورد خروجی آن فکر کنید.

نسلهای جدیدتر مدلهای هوش مصنوعی، با پاسخهای پیچیدهتر و کوتاهترشان، تشخیص اینکه چه کسی هنگام صحبت کردن نفع میبرد را دشوارتر میکنند.

شرکتهای اینترنتی آنچه شما میبینید برای تامین منافع خودشان دستکاری میکنند و این چیز جدیدی نیست. نتایج جستجوی گوگل(Google) و صفحهی فیسبوک شما با ورودیهایی پر شده که برای نمایش آنها پول دریافت شده است. فیسبوک، تیک تاک(TikTok) و سایر شرکتهای فناوری آنچه شما میبینید را دستکاری میکنند تا زمانی را که در این پلتفرم میگذرانید به حداکثر برسانند که خود به معنای بازدید بیشتر از آگهیها توسط شماست.

آنچه سیستمهای هوش مصنوعی را از سایر سرویسهای اینترنتی متمایز میکند میزان تعاملی بودن آنها است و اینکه چگونه این تعاملات به طور فزایندهای شبیه به روابط میشوند. نیازی نیست زیاد از فناوریهای امروزی فاصله بگیرید که بتوانید آیندهای را تصور کنید که در آن هوش مصنوعی سفرهایی را برای شما برنامهریزی میکند، از طرف شما مذاکره میکند یا به عنوان درمانگر و مربی در زندگی شما عمل میکند.

آنها احتمالا ۲۴ ساعته با شما خواهند بود، شما را از نزدیک میشناسند و میتوانند نیازهای شما را پیشبینی کنند. آنها در مسیر تبدیل شدن به دستیاران دیجیتال شخصی هستند.

به عنوان یک متخصص امنیت و دانشمند داده ما معتقدیم افرادی که به این هوش مصنوعیها تکیه میکنند باید به طور ضمنی به آنها اعتماد کنند تا زندگی روزمره را بگذرانند. این بدان معناست که آنها باید مطمئن شوند که هوش مصنوعی مخفیانه برای شخص دیگری کار نمیکند.

در سرتاسر اینترنت، دستگاهها و سرویسهایی که به نظر میرسد برای شما کار میکنند، در حال مخفیانه کار کردن علیه شما هستند.

تلویزیونهای هوشمند از شما جاسوسی میکنند. برنامههای تلفن همراه دادههای شما را جمعآوری کرده و میفروشند. بسیاری از برنامهها و وبسایتها شما را از طریق الگوهای تاریک فریب میدهند. این یک سرمایهداری نظارتی است و هوش مصنوعی در حال تبدیل شدن به بخشی از آن است.

در تاریکی

احتمالا شرایط با ظهور هوش مصنوعی خیلی بدتر میشود. برای اینکه دستیار دیجیتال هوش مصنوعی واقعا مفید باشد، باید شما را حتی بهتر از تلفن همراه شما و موتور جستجوگر گوگل شما بشناسد. حتی شاید از دوستان نزدیک، شرکای صمیمی و درمانگر شما نیز شما را بهتر بشناسد.

دلیلی برای اعتماد به ابزارهای مولد هوش مصنوعی امروزی وجود ندارد.

حقایق ساختگی که جیپیتی و دیگر مدلهای زبانی بزرگ تولید میکنند را فراموش کنید. انتظار میرود که با بهبود فناوری در چند سال آینده، آنها تا حد زیادی پاکسازی شوند.

اما نمیدانیم که انواع مختلف هوش مصنوعی چگونه پیکربندی شدهاند. چگونه آموزش دیدهاند، چه اطلاعاتی به آنها داده شده است و چه دستورالعملهایی به آنها داده شده تا پیروی کنند. به عنوان مثال، محققان قوانین مخفی حاکم بر رفتار چتبات مایکروسافت بینگ را کشف کردند. آنها تا حد زیادی بیخطر هستند اما میتوانند در هر زمانی تغییر کنند.

پول درآوردن

بسیاری از این هوش مصنوعیها با هزینههای هنگفت توسط برخی از بزرگترین انحصارهای فناوری ایجاد و آموزش داده میشوند. آنها برای استفاده رایگان یا با هزینه بسیار کم به مردم ارائه میشوند. این شرکتها باید به نحوی از آنها درآمدزایی کنند و مانند سایر بخشهای اینترنت، احتمالا به نوعی شامل نظارت و دستکاری میشود.

تصور کنید از چتبات خود بخواهید برای تعطیلات بعدی شما برنامهریزی کند. آیا شرکت هواپیمایی یا هتل زنجیرهای یا رستوران خاصی را انتخاب میکند که برای شما بهترین است یا جایی که شرکت سازندهی هوش مصنوعی شما با آن شراکت پنهانی دارد؟

این مشابه نتایج پولی در جستجوی گوگل و تبلیغات در فیس بوک است که احتمالا در طول زمان مخفیانهتر میشود.

اگر از چتبات خود اطلاعات سیاسی میخواهید، آیا نتایج تحت تاثیر سیاستهای شرکت سازنده آن خواهد بود؟ یا معطوف به نامزد انتخاباتی که بیشترین پول را پرداخت کرده میشود؟ یا حتی دیدگاه جمعیت شناختی افرادی که از دادههای آنها در آموزش مدل هوش مصنوعی استفاده شده است بر نتایج تاثیر دارد؟ آیا دستیار هوش مصنوعی شما مخفیانه یک جاسوس دوجانبه است؟ در حال حاضر هیچ راهی برای دانستن آن وجود ندارد.

قابل اعتماد بودن براساس قانون

ما معتقدیم مردم باید از این فناوری انتظار بیشتری داشته باشند و شرکتهای فناوری و هوش مصنوعی میتوانند قابل اعتمادتر شوند. قانون پیشنهادی هوش مصنوعی اتحادیه اروپا اقدامات مهمی را انجام میدهد که نیازمند شفافیت در مورد دادههای مورد استفاده برای آموزش مدلهای هوش مصنوعی، کاهش تعصب احتمالی، افشای خطرات قابل پیشبینی و گزارشدهی آزمایشهای استاندارد صنعتی است.

بیشتر هوش مصنوعیهای موجود از این دستورات نوظهور اروپایی پیروی نمیکنند.

هوش مصنوعیهای آینده باید قابل اعتماد باشند. تا زمانی که دولت حمایتهای قوی از مصرف کننده برای محصولات هوش مصنوعی ارائه نکند، مردم در تخمین زدن خطرات و سوگیریهای بالقوه هوش مصنوعی و کاهش بدترین اثرات آنها تنها هستند.

بنابراین، هنگامی که یک توصیه برای سفر یا اطلاعات سیاسی از یک ابزار هوش مصنوعی دریافت میکنید، با نگاه انتقادی آن را ببینید.

۵۸۵۸